Introducción

La evaluación del desempeño docente es una actividad de importancia para todo centro de enseñanza, ya que por medio de ella se puede brindar retroalimentación, con fundamento, a este personal. La Sección Técnica de Evaluación Académica (STEA) del Centro de Evaluación Académica (CEA) es una oficina que apoya a las carreras de la Universidad de Costa Rica (UCR) en esta labor. Para ello, diseñó un cuestionario compuesto de ítems o reactivos fundamentados con bibliografía de diversa índole, los cuales caracterizan el desempeño del personal educador (Kikut, 2003). Para el CEA, esta evaluación tiene como objetivo el mejoramiento de la calidad, ya que el profesorado conoce cuáles aspectos necesitan ser modificados, reforzados o eliminados; además, el personal docente, utiliza estos resultados para su promoción en el sistema de Régimen Académico de la UCR.

Las evaluaciones analizadas en este artículo corresponden al segundo ciclo lectivo, 2018 y provienen de todas las áreas de conocimiento de la UCR y de la mayoría de las sedes regionales1. Algunas unidades académicas no realizan este proceso con el apoyo del CEA, razón por la cual no se presentan en esta investigación. El último análisis, a nivel macro, elaborado en la UCR, lo realizó Kikut (2016), quien examinó la relación entre algunas características estudiantiles, académicas y la nota otorgada a cada persona docente con el responder o no el cuestionario de evaluación. La autora destaca que, a pesar de la dificultad de la unificación de las bases de datos universitarias, fue la primera ocasión en que se realizó un análisis descriptivo de este tipo a gran escala en la UCR. Por esta razón, con este artículo, se pretende brindar otras conclusiones que aporten más insumos para la mejora continua, esto, mediante el uso de técnicas multivariantes con el fin de determinar asociaciones entre variables. Además, se pretende establecer cuales características del profesorado, el estudiantado y los cursos se asocian con la calificación de la persona instructora y la actitud del alumnado hacia la materia.

Referente teórico

El instrumento que se utiliza para realizar la evaluación docente en la UCR fue fundamentado en literatura relevante relacionada con el tema, en una encuesta a estudiantes donde se indagó sobre los elementos de mayor importancia para ser incluidos y en información recabada en talleres con el profesorado, el personal administrativo y el alumnado. Con base en lo recopilado, en el CEA se construyó el cuestionario denominado “Evaluación del Desempeño Docente”, entre los años 2002 y 2003 (Kikut, 2003). Este instrumento posee relación con el perfil de competencias genéricas construido por el Consejo Universitario de la Universidad de Costa Rica (2004), el cual brinda las capacidades requeridas por la UCR con respecto al personal educador y los indicadores característicos del desempeño docente (Murillo, 2009).

Blanca, Gutiérrez, Kikut, Sánchez y Zamora (2017) afirman que no se puede hablar de la existencia formal y aprobada de un modelo de evaluación docente en la UCR. Sin embargo, los procedimientos establecidos en relación con el tema son claramente establecidos y guían tácticamente las acciones desarrolladas.

Según Tejedor (2012), calificar el trabajo del profesorado es un proceso de emisión de juicios valorativos sobre el cumplimiento de las responsabilidades de la persona educadora en la enseñanza, aprendizaje y desarrollo de sus estudiantes. Este proceso debe tener en cuenta funciones específicas que pueden expresarse en dos categorías: el domino de los saberes (saber lo que enseña, saber cómo enseñarlo, conocer los procesos de desarrollo y aprendizaje de sus estudiantes) y el dominio de las conductas (hacer lo que se ha comprometido, hacerlo bien, ser respetuoso con sus estudiantes).

Tejedor (2012) menciona que el sentido formativo de esta calificación reside en el supuesto de pensar que se estimulará a la persona instructora a realizar los cambios pertinentes en su trabajo mediante la teoría de la “disonancia cognitiva” de Festinger, la cual produce, mediante la información proporcionada, un mecanismo de retroalimentación que ocasiona cierta disonancia o insatisfacción que induce a cambiar.

Los ítems desarrollados se muestran a continuación. Cabe destacar que estos son valorados en una escala de 0 a 10, donde 0 indica el menor puntaje y 10 el mayor. El promedio simple de estos determina la nota obtenida (Kikut, 2003).

Cumple con el horario establecido para el curso.

Se encuentra disponible durante el horario que estableció para horas de consulta extra clase.

Evidencia que ha preparado clases con anticipación

Cumple con el desarrollo de los temas de acuerdo con el programa de curso

Le ayuda a tomar conciencia de la realidad del país

Muestra dominio de los temas tratados

Proporciona información e ideas actualizadas

Relaciona los temas tratados con la realidad del país cuando la materia lo permite

Utiliza ejemplos relacionados con su futura profesión, cuando la materia lo permite

Aclara satisfactoriamente las dudas que le plantea el estudiantado

Utiliza la metodología apropiada para el desarrollo de las lecciones

Utiliza los recursos didácticos apropiados para los temas que se tratan

En el desarrollo del curso, logra un balance adecuado entre la teoría y la práctica

Se interesa porque el estudiantado tenga una buena comprensión de la materia

Expone los contenidos con claridad

Logra incluir o aplicar con profundidad temas de principios, ética, valores y responsabilidad a los diferentes contenidos del curso.

Logra mantener la atención del grupo

Propicia la participación del estudiantado

Estimula al estudiantado a formar criterios propios ante diferentes situaciones

Muestra gusto al impartir las lecciones

Es accesible para que el estudiantado le haga consultas

Responde cortésmente cuando se le plantean preguntas

Mantiene buenas relaciones con el grupo de estudiantes

Lo respeta a usted como persona

Acepta críticas por parte del estudiantado

Elabora evaluaciones (exámenes, quices, tareas, asignaciones, otros) acordes con la materia planteada en clase

Formula preguntas claras en las evaluaciones que realiza

Devuelve las evaluaciones ya calificadas dentro de los diez días hábiles siguientes a su realización o entrega

Atiende reclamos en relación con la forma en que calificó las evaluaciones

Durante la validación del cuestionario, se realizó un análisis de factores en el que se encontraron 5 dimensiones que explican 74.7% de la variabilidad de la escala (Kikut, 2003):

Reglamento (del ítem 1 al 4, confiabilidad de 0.84)

Temática (del ítem 5 al 9, confiabilidad de 0.90)

Didáctica (del ítem 10 al 20, confiabilidad de 0.97)

Trato (del ítem 21 al 25, confiabilidad de 0.94)

Evaluación (del ítem 26 al 29, confiabilidad de 0.86)

Una de las interrogantes que se plantea en este estudio es la relación existente entre las características propias de estudiantes, profesorado y cursos, y las notas obtenidas.

Alaya (2013), en su artículo sobre los factores que inciden en la evaluación del desempeño docente realizado entre el alumnado de la Universidad TecMilenio campus Ciudad Juárez, llevaron a cabo un estudio cualitativo donde encontraron, entre las respuestas de las personas entrevistadas, que el tipo de materia, la personalidad docente y las calificaciones obtenidas por el estudiantado están relacionadas con la valoración docente de dicha Universidad.

Aleamoni (1999), por su parte, contrasta, con base en evidencia científica de varios autores, 16 mitos en torno a los resultados de la evaluación del personal educador. Cabe destacar que, a lo largo de los resultados, señala que las conclusiones entre los diversos estudios difieren entre sí, por lo cual surge la interrogante, en este trabajo, sobre lo que sucede en la UCR. A grandes rasgos, el autor señala que las valoraciones se ven afectadas por características como el tamaño del grupo (los grandes reciben notas más bajas), el género del estudiantado y el profesorado (resultados conflictivos), el año de carrera del alumnado (los más avanzados califican más favorablemente), la categoría en Régimen Académico y el área disciplinar (las disciplinas de ciencias sociales son mejor puntuadas en comparación con las de ingeniería y física). Sin embargo, en las conclusiones subraya que, en general, estas relaciones son mitos, por lo que no hay una relación significativa entre estas variables y los resultados del desempeño de las personas instructoras.

Arámburo Vizcarra y Luna Serrano (2013) afirman que el grado académico del personal docente tiene una relación con las notas de evaluación, ya que los que poseen grado de doctorado reciben menores puntajes en comparación con los que tienen licenciatura o maestría. Estos planteamientos también fueron abordados por Chavarría y Castillo (1987), ya que cuestionan varios aspectos relacionados con la valoración del profesorado y variables propias de los cursos, estudiantes y docentes. Entre los aspectos más relevantes se destacan los siguientes:

Se espera una asociación positiva entre las variables: años de experiencia, entrenamiento, productos profesionales del profesorado y la nota de evaluación docente; sin embargo, en algunos casos la relación es inversa, ya que con menos años de experiencia y menos títulos universitarios, frecuentemente, se encuentran mejores valoraciones.

Hay una serie de variables que pueden considerarse como contaminantes de la nota de evaluación docente por su tendencia a influir de forma positiva o negativa. Por ejemplo, el interés inicial en la materia, el sexo tanto de estudiantes como de docentes o el tamaño del grupo.

Las personas jóvenes más avanzadas en la carrera tienden a calificar sus cursos más favorablemente que las principiantes.

Algunas áreas curriculares, a nivel general, pueden ser calificadas con notas superiores en comparación con otras, por lo que es posible encontrar diferencias significativas entre las valoraciones.

Fundamentados en los cuestionamientos de la literatura consultada, en este estudio se contrasta la información de la evaluación docente en la UCR, con el fin de desmitificar aspectos relacionados con ella y aportar información relevante para la toma de decisiones por parte de las autoridades universitarias.

3. Metodología

3.1 Enfoque

El enfoque del estudio realizado fue de tipo cuantitativo con un alcance descriptivo. Se pretendió brindar un panorama sobre el desempeño del personal educador en la UCR. Para ello, el análisis se centró en la descripción de variables ligadas al profesorado y su relación con características de los cursos y del estudiantado.

3.2 Unidad de análisis

La población bajo estudio fue el personal docente evaluado por el estudiantado matriculado en cursos durante el segundo ciclo lectivo del año 2018 por el CEA en la UCR. Para la obtención y uso de las bases de datos, se solicitó la autorización de la dirección de esta oficina.

En total se consideraron 57 148 evaluaciones para el análisis, las cuales abarcan: 1 772 cursos, 5 082 grupos y 3 029 docentes. La STEA brinda apoyo solamente a las unidades académicas o carreras que lo solicitan a nivel de pregrado o grado, por lo cual este trabajo no incluye la totalidad de los cursos y de los grupos de la UCR. Un aspecto para resaltar es que la Sede de Occidente no realizó evaluación del profesorado durante el período de análisis.

3.3 Técnicas de recolección

Las bases de datos utilizadas para el análisis se extrajeron de las secciones de Cargas Académicas, Régimen Académico y Evaluación Académica del CEA. De las dos primeras, se obtuvieron variables características del profesorado, como el sexo, grado académico, edad en años cumplidos, categoría en régimen académico y el tipo de curso2. De la sección de Evaluación Académica, se obtuvieron las evaluaciones del desempeño docente, las cuales incluyen variables del estudiantado, como sexo, edad, condición laboral, año de carrera, si lleva el curso por primera vez, actitud desarrollada por la persona docente hacia la materia3 y los ítems del instrumento plasmados en las referencias teóricas. Las variables estudiantiles analizadas fueron las recopiladas a partir del cuestionario de evaluación docente, ya que no se tuvo acceso a bases de datos universitarias con información de esta población.

3.4 Procesamiento y análisis

En primer lugar, se procedió a unir las bases de datos, donde se utilizó el nombre de la persona instructora como llave para empatarlas. Esta llave tuvo que ser depurada con minuciosidad debido a que, para la evaluación docente, la STEA recibe los nombres del profesorado y los cursos a evaluar por parte de la Unidad Académica que la solicita4. Por esta razón, estos nombres no son exactamente iguales a los que se encuentran en las bases de datos universitarias, ya que cada Unidad Académica que hace la solicitud, construye sus propios listados, los cuales en muchos casos son digitados manualmente.

Una vez logrado el empate de las bases de datos, se procedió a realizar una depuración de la base construida. En dicha depuración se realizó lo siguiente:

Se sustituyeron algunos de los valores faltantes de la variable sexo del personal educador con base en su nombre. Esta sustitución se realizó basándose en el conocimiento popular; por ejemplo, si la persona docente con nombre faltante se llamaba ‘Ana’, se le asignó ‘Mujer’ y si, en caso contrario, poseía el nombre de ‘Carlos’, se le asignó ‘Hombre’. En casos donde, por conocimiento popular, no se logró determinar el sexo basado en el nombre se dejó el valor como vacío.

Se sustituyeron los valores faltantes y se corrigieron las inconsistencias de la variable grado académico del docente con base en la variable categoría en régimen académico: si la categoría en régimen académico era “interino bachiller” se colocó ‘bachiller’ y si esta era interino licenciado se colocó ‘licenciado’.

Las variables grado académico y categoría en régimen académico fueron construidas a partir de la base de datos de cargas académicas del CEA, en dicha base de datos se reporta al profesorado, según la cantidad de nombramientos que posea; es decir, la persona docente aparece en varios registros, en muchas ocasiones, con una categoría en régimen académico diferente. La categoría en régimen académico como variable construida para efectos de este trabajo es la más alta reportada en los múltiples nombramientos.

Se depuraron las siglas mal escritas de los cursos con base en la guía de horarios del segundo ciclo lectivo del año 2018.

Se eliminaron las evaluaciones de la carrera Marina Civil debido a las dificultades que enfrentó el programa de estudios durante el período contemplado en este estudio.

Se recodificaron las siglas de cursos RP en los casos donde existe una sigla diferente con el mismo nombre del curso de sigla RP. Por ejemplo, el curso de la Escuela de Geografía llamado ‘Geografía Mundial’ posee dos siglas en esta unidad académica: RP3412 y GF0103. Ante esta situación, se recodificaron los casos con sigla RP3412 por GF0103.

Se depuró la variable cantidad de estudiantes en el grupo con base en las evaluaciones realizadas en cada uno de la siguiente manera: en los casos donde se realizaron más registros en comparación con la cantidad de alumnos reportados como matriculados, se sustituyó la cantidad de matriculados por el número de evaluaciones realizadas. Cabe destacar que la suma de estudiantes por grupo está sujeta a la manera en que las unidades académicas los reportan; es decir, algunas gestionan utilizar una misma aula para varios grupos o, en caso contrario, varias aulas para uno solo. Por esta razón, los tamaños, definidos para efectos de este artículo como el número de estudiantes que reciben un curso en un mismo espacio, se encuentra subestimado o sobreestimado en algunos casos.

Se eliminaron los casos donde el estudiantado marcó en más de 10 ocasiones la opción ‘no sabe’ o el valor era faltante en las preguntas (aproximadamente 1,9% del total de los casos). En las evaluaciones donde se encontraron 10 o menos valores ‘no sabe’ o vacío, se optó por sustituir estos valores con el promedio de la variable dentro del grupo evaluado.

Aunado a la depuración de las bases de datos, se construyó una variable que se le llamó: categoría del curso. Las categorías de esta variable fueron las siguientes:

Artes

Letras

Ciencias agroalimentarias

Ciencias básicas

Ciencias sociales y derecho

Ciencias económicas

Educación

Ingeniería

Salud

Generales

Para la construcción de estas categorías se utilizó la distribución por área de las carreras de la Sede Rodrigo Facio de la UCR. Cabe destacar que algunas áreas fueron desagregadas de la siguiente manera debido a su gran cantidad de carreras:

Artes y Letras:

Artes

Letras

Ciencias Sociales:

Ciencias Sociales y Derecho

Ciencias económicas

Educación

Para la creación de la variable de categoría del curso en la base de datos, se tomaron los dos primeros caracteres alfanuméricos de cada sigla. Al par de caracteres le fue asignado una categoría de la variable según su pertenencia a una carrera o unidad académica que, a su vez, pertenece a un área de la UCR. En el caso de las Sedes Regionales, la asignación de las categorías de la variable a los caracteres se realizó según la afinidad de la carrera dueña del par de caracteres con las áreas establecidas de la sede Rodrigo Facio.

Para el análisis de la información se utilizaron dos técnicas multivariantes: análisis de conglomerados y análisis de correspondencias. El análisis por conglomerados se realizó para clasificar al profesorado universitario en subgrupos con base en las preguntas del instrumento y las características sociodemográficas. Por su parte, el análisis de correspondencias fue utilizado con el fin de detectar asociaciones entre variables para aclarar interrogantes en torno a la evaluación del desempeño docente en la UCR.

Es importante subrayar que el análisis de correspondencias es un método de componentes principales que grafica dos variables nominales representadas en una tabla de contingencia con el fin de encontrar asociaciones entre ellas. Para la construcción del gráfico de correspondencias, esta técnica se basa en la medida estandarizada chi cuadrado, la cual es utilizada como una medida de distancia entre las categorías de las variables analizadas. Para esto, se calculan dos matrices de distancias, una para las columnas y otra para las filas de la tabla de contingencia, donde la distancia entre dos filas i y j se definen como:

Donde

A partir de las matrices de distancias, se aplican dos escalamientos multidimensionales respectivamente. Con base en estos resultados, se obtienen dos grupos de coordenadas las cuales al graficarse en conjunto generan el gráfico de correspondencias (Fernández 2011).

Cabe destacar que el método normalización utilizado para este análisis fue el de normalización simétrica, ya que se examinan las diferencias y similitudes entre las categorías de ambas variables en cada caso. Previo a realizar cada análisis de correspondencia, se realizó una prueba chi cuadrado con el fin de verificar una relación entre cada par de variables por analizar con un nivel de significancia de 0,05.

Los paquetes utilizados para el análisis de la información fueron Microsoft Office Excel 365 y SPSS versión 20.

4. Resultados

La Tabla 1 muestra las características sociodemográficas del personal instructor evaluado.

Tabla 1 Características sociodemográficas del personal docente de la UCR evaluado en el segundo período 2018 .(En porcentajes)

| Variables | Número de docentes (*) |

| Sexo | 3 025 |

| Hombres | 59.5 |

| Mujeres | 40.5 |

| Edad del docente en grupos | 2 880 |

| Entre 22 y 30 años | 12.3 |

| Entre 31 y 40 años | 34.1 |

| Entre 41 y 50 años | 24.1 |

| Entre 51 y 60 años | 23.9 |

| 61 años o más | 5.6 |

| Categoría en régimen académico | 2 958 |

| Catedrático(a) | 5.7 |

| Asociado(a) | 8.4 |

| Adjunto(a) | 3.6 |

| Instructor(a) | 13.5 |

| Interino en régimen | 0.2 |

| Interino licenciado(a) | 61.4 |

| Interino bachiller | 3.7 |

| Otros: categoría especial, invitado, visitante | 3.5 |

| Grado académico | 2 915 |

| Bachillerato universitario | 4.0 |

| Licenciatura | 44.5 |

| Maestría | 37.0 |

| Doctorado académico | 14.5 |

*El total de docentes en cada característica sociodemográfica varía debido a valores faltantes.

Fuente: Elaboración propia, con información del CEA, 2020

La Tabla 2 muestra la distribución porcentual del número de cursos, grupos y de evaluaciones realizadas según la clasificación de cursos establecida. La proporción de evaluaciones realizadas en cursos de Estudios Generales es muy baja debido a que la Escuela

de Estudios Generales de la sede central Rodrigo Facio no realiza evaluación del desempeño docente con el CEA.

Tabla 2 Distribución porcentual del número de cursos, grupos y evaluaciones realizadas según categoría del curso en la UCR, segundo período 2018.

| Categoría del curso | Número de cursos | Número de grupos | Evaluaciones |

| Total | 1 772 | 5 082 | 57 148 |

| Artes | 7.1 | 5.6 | 3.9 |

| Letras | 10.9 | 9.3 | 9.7 |

| Ciencias agroalimentarias | 2.6 | 1.9 | 2.4 |

| Ciencias básicas | 13.2 | 14.5 | 17.1 |

| Ciencias sociales y derecho | 13.0 | 12.5 | 16.1 |

| Ciencias económicas | 6.5 | 12.2 | 10.7 |

| Educación | 13.8 | 9.1 | 13.0 |

| Ingeniería | 18.8 | 16.2 | 14.5 |

| Salud | 12.6 | 15.6 | 8.5 |

| Generales | 1.5 | 3.1 | 4.1 |

Fuente: Elaboración propia, con información del CEA, 2020

En cuanto a los cursos evaluados, la mayor proporción fueron propios (77.0%), seguidos por cursos de servicio (12.1%), y, en menor proporción, mixtos (10.9%). Algunos cursos propios son, en la práctica, mixtos debido a que los reciben varias carreras. Sin embargo, estas codificaciones no se encuentran totalmente actualizadas, por lo que la cantidad de cursos propios se encuentra sobreestimada.

Respecto al número de grupos según cantidad de estudiantes, se encontró que un 12.6% de los evaluados poseen entre 1 y 10 estudiantes, un 60.6% entre 11 y 30 estudiantes, un 22.0% entre 31 y 50 estudiantes y un 4.8% más de 50 estudiantes.

En 53 764 evaluaciones, el 80,9% del estudiantado reportó no trabajar, el 10,9% laborar 20 horas a la semana o menos y 8,2% más 20 horas a la semana. En 53 837 valoraciones, este mismo, reportó ubicar la mayor parte de los cursos matriculados en el ciclo lectivo de la siguiente manera: primer año un 25,3%, segundo un 27,4%, tercero 21,4%, cuarto 16,5%,

quinto 9,4%.

Con el fin de clasificar al profesorado, según las puntuaciones obtenidas, se procedió a realizar un análisis de conglomerados. En primer lugar, se calcularon los promedios por pregunta de evaluación para cada docente en cada grupo. Para efectos de este análisis, cada persona educadora puede estar representada en repetidas ocasiones según la cantidad de

grupos que impartió. Además, se construyeron cinco indicadores a partir de las dimensiones del cuestionario presentadas en el marco teórico. El cálculo de cada indicador fue el promedio simple de las puntuaciones de las preguntas que componen la dimensión que lo define.

El promedio simple de los cinco indicadores construidos constituyó la calificación donde la mayoría resultó bien evaluada (88.1%), ya que puntuó un promedio mayor a 8. Una nota menor puede clasificarse como que la persona tiene aspectos por mejorar.

Para la definición del número de conglomerados, se procedió a realizar varias corridas utilizando el método de k medias. La Tabla 3 muestra los centros de los conglomerados construidos (entre 2 y 5). Se determinó que 4 son los que describen de mejor manera al profesorado, porque al construir 5, el número de docentes que se agrupan en el quinto conglomerado es muy pequeño. Con base en los centros de estos 4, se estableció que cada uno se compone de la siguiente manera:

Grupo 1: Los mejores docentes (Muy buenos).

Grupo 2: Docentes buenos con aspectos por mejorar (Buenos).

Grupo 3: Docentes con notas regulares, ya que los centros del conglomerado son menores a 8 (Regulares).

Grupo 4: Docentes deficientes (Deficientes).

Tabla 3 Centros de los diferentes conglomerados construidos (entre 2 y 5) según el método de k-medias utilizando los indicadores que resumen el cuestionario de evaluación docente de la UCR

| Indicadores | 1 | 2 | 3 | 4 | 5 |

| Tamaño | 3 973 | 764 | - | - | - |

| Reglamento | 9.5 | 7.6 | - | - | - |

| Temática | 9.4 | 7.2 | - | - | - |

| Didáctica | 9.2 | 6.6 | - | - | - |

| Trato | 9.6 | 7.5 | - | - | - |

| Evaluación | 9.4 | 7.1 | - | - | - |

| Tamaño | 3 307 | 1 136 | 294 | - | - |

| Reglamento | 9.7 | 8.6 | 6.6 | - | - |

| Temática | 9.5 | 8.3 | 6.2 | - | - |

| Didáctica | 9.4 | 7.9 | 5.4 | - | - |

| Trato | 9.7 | 8.7 | 6.5 | - | - |

| Evaluación | 9.5 | 8.2 | 6.2 | - | - |

| Tamaño* | 2 765 | 1 311 | 518 | 143 | - |

| Reglamento | 9.7 | 9.0 | 7.9 | 5.8 | - |

| Temática | 9.6 | 8.8 | 7.5 | 5.5 | - |

| Didáctica | 9.6 | 8.5 | 6.9 | 4.6 | - |

| Trato | 9.8 | 9.1 | 7.8 | 5.8 | - |

| Evaluación | 9.6 | 8.7 | 7.4 | 5.4 | - |

| Tamaño | 2 374 | 1 379 | 657 | 262 | 65 |

| Reglamento | 9.8 | 9.3 | 8.4 | 7.1 | 5.2 |

| Temática | 9.7 | 9.0 | 8.1 | 6.6 | 4.9 |

| Didáctica | 9.6 | 8.8 | 7.6 | 5.9 | 3.8 |

| Trato | 9.8 | 9.3 | 8.4 | 7.1 | 4.9 |

| Evaluación | 9.7 | 9.0 | 7.9 | 6.7 | 4.4 |

*Cantidad seleccionada de conglomerados. La convergencia de la corrida se logró con 38 iteraciones.

Fuente: Elaboración propia, con información del CEA, 2020

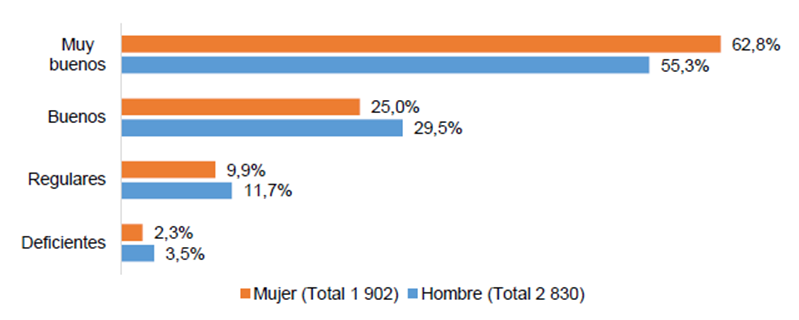

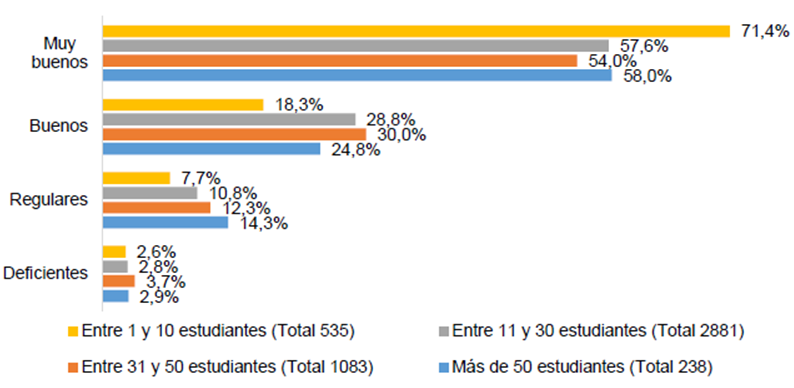

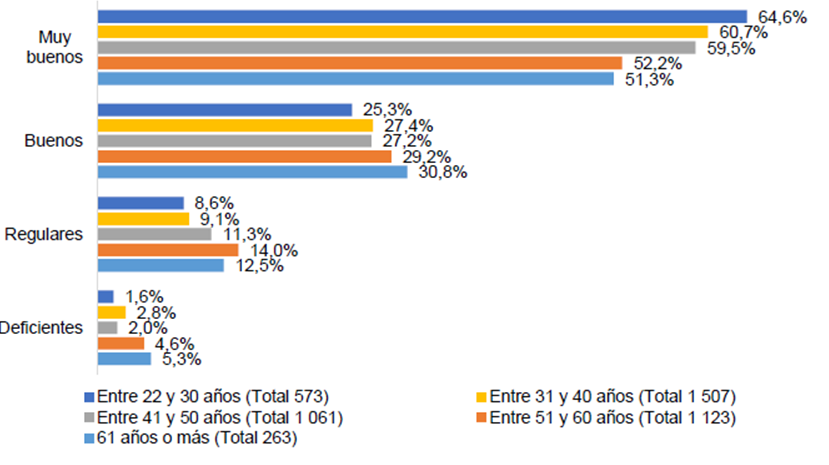

Con el fin de determinar si los conglomerados tienen relación con las características del profesorado, se realizaron pruebas chi cuadrado de Pearson. No se encontró suficiente evidencia estadística, al 5% de nivel de significancia, para rechazar la hipótesis de independencia entre las variables grado académico y categoría en régimen académico del personal docente con los conglomerados construidos. Para las variables sexo, tipo de curso, tamaño del grupo, edad de la persona docente y categoría del curso se rechazó la hipótesis de independencia con un 5% de nivel de significancia. Se encontró que hay una mayor proporción de docentes mujeres clasificadas como muy buenas en comparación con los hombres (Figura 1). En grupos entre 1 y 10 estudiantes el profesorado es mejor calificado (Figura 2). Respecto de la edad, la proporción de personas educadoras con edades de 51 años o más, que se clasifican como muy buenas, es menor en comparación con las de menor edad (Figura 3).

Fuente: Figura 1 Elaboración propia, con información del CEA, 2020 Distribución porcentual del personal docente de la UCR por conglomerado de pertenencia según sexo en el segundo período 2018

Fuente Figura 2 Elaboración propia, con información del CEA, 2020 Distribución porcentual del personal docente de la UCR por conglomerado de pertenencia según tamaño del grupo en el segundo período 2018

Fuente: Figura 3 Elaboración propia, con información del CEA, 2020 Distribución porcentual del personal docente de la UCR por conglomerado de pertenencia según edad en el segundo período 2018

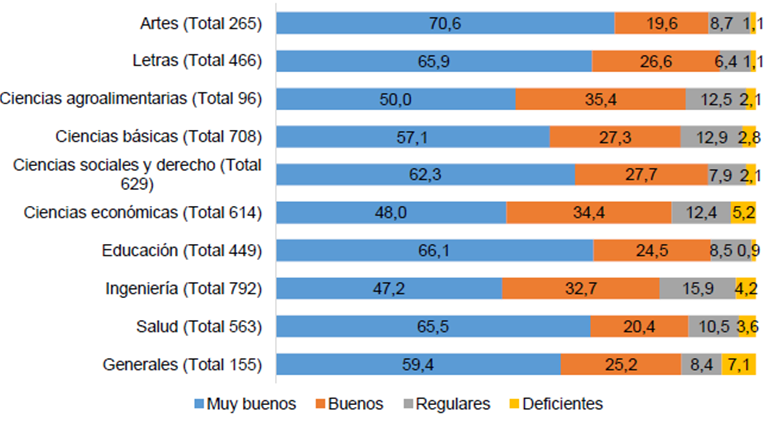

En la Figura 4 se muestra la distribución porcentual del profesorado por conglomerado de pertenencia según la categoría del curso. Como se puede notar, se clasifica en mayor proporción como muy bueno el personal educador de los cursos de artes, letras, educación y salud; en caso contrario, se clasifican en mayor proporción como deficientes docentes de los cursos de ciencias económicas, ingeniería y generales.

Fuente Figura 4 Elaboración propia, con información del CEA, 2020 Distribución porcentual del personal docentede la UCR por conglomerado de pertenencia según categoría del curso en el segundo período 2018

La Tabla 4 muestra la distribución porcentual de la variable actitud desarrollada por el personal docente hacia la materia. Con el fin de describir la relación entre esta variable y otras relacionadas con el profesorado, el curso y el estudiantado, se procedió a realizar un análisis de correspondencias para cada cruce entre ellas.

Tabla 4 Distribución porcentual de actitud hacia la materia desarrollada por el personal docente de la UCR en el segundo período 2018

| Actitud hacia la materia | Abreviatura* | Porcentaje |

|---|---|---|

| Total | - | 56 945 |

| Al inicio tenía interés y lo perdió | T int y lo perdió | 9.9 |

| Al inicio no tenía interés y sigue sin tenerlo | NT int sigue sin int | 6.2 |

| Al inicio no tenía interés y ahora sí | NT int y ahora sí | 10.4 |

| Al inicio tenía interés y lo mantiene | T int y lo mantiene | 35.8 |

| Al inicio tenía interés y aumentó | T int y aumentó | 26.5 |

| El docente no ha influido en la actitud hacia la materia | Doc no ha influido | 11.2 |

*Se muestran las abreviaturas de cada categoría utilizadas en los análisis de correspondencias las cuales fueron construidas con el fin de facilitar la lectura de los gráficos. Fuente: Elaboración propia, con información del CEA, 2020

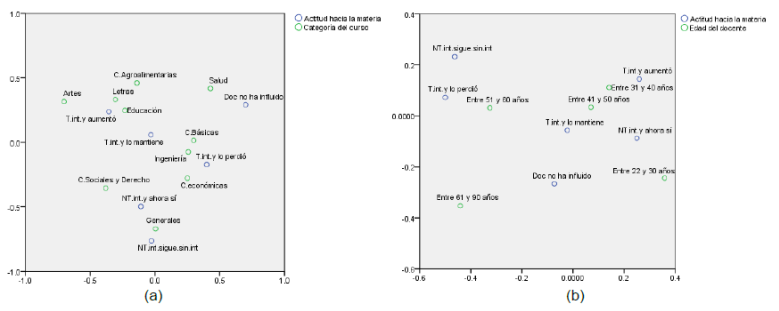

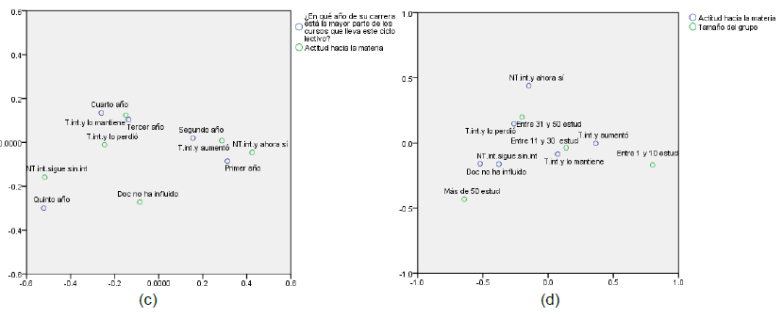

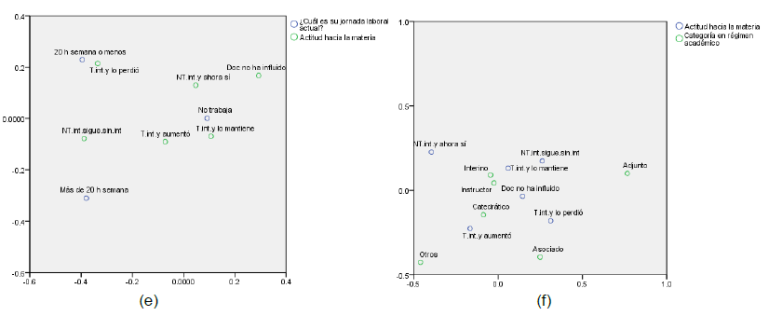

En resumen, se analizan las variables de categoría del curso (Figura 5a), edad de la persona docente (Figura 5b), año de carrera donde se encuentra la mayor cantidad de cursos que matriculó el estudiantado (Figura 5c), tamaño del grupo (Figura 5d), condición laboral del alumnado (Figura 5e) y categoría en régimen académico de profesorado (Figura 5f) y su asociación con la variable de actitud desarrollada por la persona instructora hacia la materia. En todos los casos presentados se rechazó la hipótesis de independencia con un nivel de significancia de 0,05.

Figura 5 Análisis de correspondencias entre variables categoría del curso, edad de la persona docente, año de carrera del estudiantado, tamaño del grupo, condición laboral del estudiantado y categoría en régimen académico del profesorado, y la variable de actitud desarrollada por el profesorado hacia la materia. UCR, segundo período 2018

Figura 5 Análisis de correspondencias entre variables categoría del curso, edad de la persona docente, año de carrera del estudiantado, tamaño del grupo, condición laboral del estudiantado y categoría en régimen académico del profesorado, y la variable de actitud desarrollada por el profesorado hacia la materia. UCR, segundo período 2018 (continuación)

Fuente Figura 5 Elaboración propia, con información del CEA, 2020 Análisis de correspondencias entre variables categoría del curso, edad de la persona docente, año de carrera del estudiantado, tamaño del grupo, condición laboral del estudiantado y categoría en régimen académico del profesorado, y la variable de actitud desarrollada por el profesorado hacia la materia. UCR, segundo período 2018 (continuación)

En la Tabla 5 se resumen las principales correspondencias encontradas en la Figura 5. Se muestran las categorías de variables donde hay una cercanía con la actitud hacia la materia. Las relaciones expuestas deben ser interpretadas como patrones encontrados; por ejemplo, en el caso de la categoría del curso ‘Generales’, la cual se encuentra en la Tabla 5 con las categorías: ‘al inicio no tenía interés y sigue sin tenerlo’ y ‘no tenía interés y ahora sí’, las cercanías halladas en el análisis explican que existe una mayor proporción de docentes de estudios generales que no generan un interés hacia la materia o que sí la generan cuando al inicio no había interés en comparación con el profesorado de otras categorías de cursos.

Tabla 5 Principales correspondencias entre las categorías de la variable de actitud desarrollada por el profesorado hacia la materia y variables relacionadas con el personal docente, cursos, estudiantes y grupos. UCR, segundo período 2018

| - | Categorías de variables donde se encontró correspondencia con actitud hacia la materia | - | - | - | - |

| Actitud hacia la materia | Categoría del curso | - | - | - | - |

| Al inicio tenía interés y lo perdió | Ciencias básicas, ingeniería, ciencias económicas | Edad del docente | Año de carrera del estudiantado | Tamaño del grupo | Condición laboral del estudiante |

| Al inicio no tenía interés sigue sin tenerlo | Generales | Entre 51 y 90 años | Cuarto año | Entre 31 y 50 estudiantes | Trabaja |

| Al inicio no tenía interés y ahora sí | - | - | Quinto año | - | Trabaja |

| Al inició tenía interés y lo mantiene. | - | - | Primer año | - | No trabaja |

| Al inicio tenía interés y aumentó | Artes, letras y educación | - | Tercer año, Cuarto año | Entre 1 y 30 estudiantes | No trabaja |

| El docente no ha influenciado en la actitud hacia la materia | Salud | - | - | Entre 1 y 30 estudiantes | No trabaja |

Fuente: Elaboración propia, con información del CEA, 2020

En resumen, como se puede notar, existe una relación entre: docentes de mayor edad, estudiantes de años avanzados en la carrera, grupos grandes y estudiantes con trabajo, con una actitud negativa hacia la materia. En caso contrario, estudiantes de los primeros años, los grupos pequeños y la condición de no trabajar poseen relación con una actitud positiva hacia la materia. La relación encontrada en el tamaño del grupo la destaca Aleamoni (1999), quien indica que, en general, el profesorado con grupos pequeños recibe mejores calificaciones debido a que se logra tener mayor interacción con el profesor o profesora. Reducir los tamaños de grupo implicaría mayor gasto a nivel presupuestario, ya que se tendría que aumentar su cantidad, por lo que es importante revisar las prácticas pedagógicas del personal educador con grupos grandes, de modo que, al implementar estrategias para una mejor interacción entre docentes y estudiantes, mejore el desempeño de ambos. Esta recomendación la respalda Sobrados (2016) en su trabajo con grupos grandes, donde implementa un método de aprendizaje basado en una participación más activa del estudiantado. En general, dicha metodología recibió mejores valoraciones por parte del alumnado en comparación con los métodos tradicionales de enseñanza.

En el caso de los cursos, las categorías de artes, letras y educación promueven, en mayor proporción, interés hacia la materia en comparación con las ciencias básicas, ingeniería, ciencias económicas y generales, donde el poco interés y la pérdida de este son aspectos que se reflejan en estas áreas con mayor frecuencia. Un patrón similar pero no igual se encontró en los conglomerados construidos, ya que se hallaron más docentes con notas deficientes en las áreas de ingeniería, ciencias económicas y generales. Cabe destacar que estas diferencias observadas en las evaluaciones y en la actitud hacia la materia por área disciplinar también las subrayan Aleamoni (1999), y Castillo y Chavarría (1987).

En cuanto a la relación con la variable de categoría en régimen académico, no se encontró ninguna asociación sobresaliente en la Figura 5f de correspondencias. Para explicar sustantivamente las relaciones encontradas, se debe realizar una investigación cualitativa con el estudiantado y el personal docente.

Conclusiones

Las autoridades universitarias y el CEA tienen bajo su responsabilidad motivar a todas las unidades académicas a realizar evaluación del desempeño docente en todos los períodos lectivos, de modo que cada persona educadora reciba una retroalimentación de sus labores por parte del estudiantado.

Dadas las múltiples fuentes de información universitaria y sus diversas estructuras, realizar análisis similares al presentado en esta investigación u otros más complejos, requiere de un arduo trabajo de depuración de las bases de datos. Por tal razón, es de importancia para la UCR invertir recursos para mejorar la infraestructura y calidad de sus bases de datos, de modo que en un futuro se facilite el acceso y análisis de la información universitaria para la toma de decisiones.

Es recomendable que en el CEA se cambie y estandarice la forma en que las unidades académicas confeccionan los listados de docentes por evaluar, de modo que el nombre del profesorado se pueda empatar más fácilmente con las demás bases de datos universitarias, por ejemplo, con el uso del número de empleado.

La metodología de depuración de bases de datos y las técnicas estadísticas utilizadas pueden ser una guía para facilitar el desarrollo de futuras y más complejas investigaciones sobre la labor del profesorado en la UCR, ya que a pesar de que requieren gran cantidad de tiempo son sencillas de utilizar.

Es preferible la apertura de más grupos en cursos de alta demanda en vez de aumentar el cupo de los existentes, dada la relación encontrada entre una actitud negativa hacia la materia y los grupos grandes. Sin embargo, una revisión de la metodología de enseñanza en grupos grandes es pertinente dada la situación presupuestaria que impide la apertura de un mayor número.

Con el fin de explicar las razones por las cuales el estudiantado más avanzado en la carrera, en mayor proporción, pierde el interés hacia la materia al igual que el que trabaja, es necesario realizar investigaciones cualitativas que expliquen las razones de estos patrones. Una posible explicación puede ser la experiencia que posee el alumnado más avanzado que trabaja, ya que podrían poseer más criterios para evaluar los diferentes aspectos del desempeño docente. Es importante en ese sentido que las unidades académicas revisen la metodología de enseñanza del profesorado que promueve una actitud hacia la materia donde la persona estudiante al inicio tenía interés y lo perdió.

En general, en los conglomerados conformados y en los puntajes generales de evaluación docente, la mayoría del profesorado es evaluado con un buen desempeño en su labor. Las mujeres, por su parte, son mejor calificadas que los hombres, así como el personal más joven, en comparación con el de mayor edad.

En un futuro es necesario realizar un análisis factorial confirmatorio de los factores encontrados por Kikut (2003), con el fin de brindarle un mayor respaldo estadístico al instrumento del CEA.

Un nuevo horizonte posible de investigación cuantitativa, a gran escala, en la UCR, es el estudio de la relación entre la nota de evaluación y la actitud desarrollada hacia la materia sobre las notas del estudiantado y las horas de dedicación al curso. Para ello, se puede tomar en cuenta variables como la dificultad y exigencia percibida por parte del alumnado respecto al curso y la persona docente respectivamente.